延续第一期的大咖阵容,这期的嘉宾也是或已经功成名就的学者,或拿奖到手软的青年才俊,或业界的资深专家。他们分别为美国伊利诺伊大学芝加哥分校 (UIC) 特聘教授俞士纶、美国密歇根大学梅俏竹教授、北京大学的王立威教授、百度高级研究员李兴建。以下便是此次研讨会的精彩内容。

王立威:对 AutoML 的简单介绍

对于机器学习,大家可能有所了解,给你一些数据,然后得到一个识别图像的分类器,或者语言翻译器。在机器学习过程中会运用到很多模型,涉及到一些超参数。在过去,这些模型的设计和超参数的调节,全都是根据人的经验积累,AutoML 的想法是把模型设计、超参数的调节全部变成一种自动的学习过程,而不借助人的经验。

这里可以用数学公式来定义,简单来说,对于你给定的一个任务,希望机器能够自动学习模型的结构和设置,并能达到最优层级。举个例子,过去大家用得比较多的是 ResNet 或者 DesNet,这些网络结构都是通过经验,人为设计出来的。现在谈到 AutoML,我们希望网络结构的设计变成一个优化问题,由机器学习出来。

我的学生把深度学习的调参叫做炼丹,我相信真正做过这件事情的人都有同感。古代的术士去炼丹,火候要掌握到什么程度,需要多长时间,这些都凭长期的经验积累。当我们把这件事情变成机器自动的过程,自己去找到最优的超参数,而不是人在那儿炼丹,这应该是 AutoML 非常大的意义。

另外,传统的一些网络由人为设计,它们结构简单,具有对称性,看起来很规则。但是现在,完全可以用学习的方式,来学出网络的拓扑结构,学到的结构可能极其复杂,但从效果上来说,针对一些具体问题,这个网络可能要比人为设计的网络效果明显要高。

梅俏竹:可解释机器学习与自动机器学习并不矛盾

自动机器学习与可解释机器学习并不矛盾。全自动的机器学习,可以具有可解释性,可解释机器学习也可以是自动的。

考虑一个简单的问题,在做诊断时,一个强大的机器学习诊断系统能够读 X 光片,能够判断出患者是否患病。但是我们不仅要做诊断,还要把诊断结果描述给患者听,最终让病患接受医生的建议。

在这个流程里面,如果用传统的机器学习方法,数据(即 X 光片)已经给到,AutoML 能够自动学出该用什么样的网络以及超参数,然后做出决定。但这里存在一个问题,医生能不能接受?如果医生都很难接受,那病人就更难接受了,因为我解释不清楚为什么诊断为这个病。

可解释机器学习就是想解决这个问题,它会告诉我为什么出现这种诊断结果。他会站在医生和病人的角度,告诉他们自己希望了解的内容。这是可解释性机器学习的愿景,与自动机器学习并不矛盾,可解释性是建立信任人与 AI 的信任的必然路径。

百度高级研究员李兴建:从产业界讲 AutoML

人脑的结构,其实经历了上亿年的进化,优质的品种得到保留,劣质的品种逐步被淘汰。研究人员在神经网络设计方面也做了类似的实验,从一些结构简单、效果比较差的网络开始,通过不断进化的方式,来观察神经网络模式的变化,最后通过大量的计算,演化出效果非常好的网络。这是比较早的关于神经网络结构的探索。现在比较主流的,像基于进化算法、强化学习或者可微结构的算法都是神经网络结构搜索的主要方法。

百度在生成对抗网络(GAN)的结构上也做了一些搜索,我们针对上采样进行了结构搜索,最后发现搜索出来的 GAN 比人设计的网络更稳定,并且生成的效果更好。另一个实践是比较形象的应用,我们对头像风格迁移的任务模型进行搜索,使用多个 auto encoder 进行叠加,最后发现这样的多尺度特征融合只需要非常少的操作和连接,就可以达到同样甚至更好的效果。

这是企业做的一些基础性工作,另外在产品和服务里,也有一些应用,比如百度正在使用 AutoML,利用精度更高或速度更快的模型来为大家提供在线服务。除了算法方面的自动化,还有很多流程上的自动化,最终将产生一个从算法到流程全自动化的工具包。

王立威:在很多问题里,可解释性是很片面的

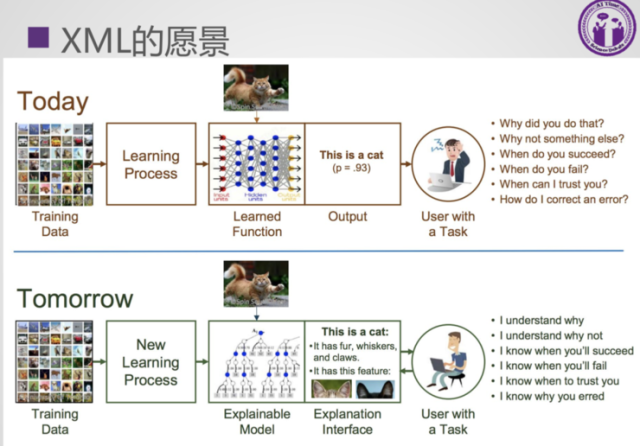

我说说我的一个看法,这是从另外一个视角。大家可以看看下面这张 PPT,这是可解释机器学习的愿景。

这张图里,我们希望神经网络识别出一只猫,对猫的判断是它有皮毛和爪子。再深入一点,请解释什么是皮毛和爪子,你马上就会发现神经网络不能解释。我的观点是,在很多问题里,可解释性是很片面的,大部分问题本质上不可解释。

在过去大概三四年里,我做了很多和医疗相关的机器学习问题,刚才几位嘉宾和主持人都谈到医疗里的可解释是一个很重要的诉求,但是在我过去三四年的经验积累里,我发现只有在最开始阶段,当医生还不完全信任人工智能系统的时候,可解释可能是有必要的,一旦医生信任了这一系统,系统性能达到甚至超过医生,可解释性就不再是一个很必要的问题。

医疗里大量的问题和猫的问题一样,你去拍 X 光片,认为这个地方有可能是肺癌,给出的解释是看到这个地方有毛刺和空洞,但是请解释毛刺、空洞分别是什么定义。之所以今天的人工智能、机器学习会在一些性能上超越人类,正是因为在这些我们很难解释,甚至是不可解释的特征上,他们做的远远超过人类。

再说一说为什么刚才说的皮毛和爪子不可解释。将猫分解为皮毛和爪子来识别,这是大大可以压缩的模型。但本质上可能不存在一个能用简短语言描述的模型,来非常清楚地判断是不是皮毛,这时候就不可解释了,因为解释一定要能用简短的语言描述出来。假如我用一个包含一亿参数的模型表述出来的神经网络能够判断是不是皮毛,这也是一种解释,只是这种解释太复杂了,人没有办法理解。

以上便是我对可解释的一个看法,我们不一定非要追求可解释,需要看能不能解释。

对 AutoML 技术层面上的一些看法

俞士纶:AutoML 在一些比较容易的事情上还是比较可靠的,比如当输入全是图片,但是真正涉及到比较复杂的问题就比较难了。比如做交通预测,从一个点到另外一个点需要花多少时间,这里有历史数据,有实时数据,另外还涉及到天气数据,还有一些源自社交网站的文本数据。最后需要看怎样把各种不同的数据融合在一起,涉及到的东西太多,像这种复杂的问题,还是不可能完全自动化。

王立威:ACL2019 有一篇很有名的 paper,计算了各种模型所产生的计算量和碳排放,这是从社会的角度来看这种技术。

对于一些企业来说,尽管不是很懂 AutoML 的原理,但是也会用这种自动的方式去搜索有助于业务的网络结构。最后可以看看云计算的花费,会有一家企业愿意花几十万甚至上百万美元去搜索一个很好的网络结构吗?这样付出的成本可能比最后挣的钱还多。

我支持 AutoML 这个大方向,在一些不需要用人力的地方,我们用机器,但是我们要限制盲目的搜索,以减少消耗,将人为设计和自动学习两者有机结合。

AutoML&Explainable ML 未来之路

王立威:稍微谈谈自动机器学习和可解释机器学习的未来之路,我觉得机器学习比较擅长的是底层信号(图像、语音或者文本数据)的分类与检测任务,在知识层面比较欠缺。如果在未来想让 AutoML 变得非常自动化,实际上需要对网络结构有更高层面的理解,同样,我们所谓的解释通常都是依据人的知识在做一些解释,我认为自动机器学习和可解释机器学习未来的发展与机器学习领域的发展将会很一致,向更高层的知识提高。

梅俏竹:我认为自动机器学习和可解释机器学习并不矛盾,这两者可以结合。如果为了全自动,把人类的经验全部抛开,用极大量的资源去做,这肯定是一种浪费,而且效果不好;另外,也不能说为了让神经网络可以让人理解,就非要在理解这个层面纠结,大家对理解的定义各不相同。

114 thoughts on “「AI Time」science debate 第二期:论道自动机器学习与可解释机器学习”